Регрессионный анализ является одним из основных инструментов в статистике и машинном обучении, позволяющим строить модели, предсказывающие взаимосвязь между зависимыми и независимыми переменными. Один из самых популярных инструментов для проведения регрессионного анализа - R Studio, мощная среда разработки на языке программирования R.

В этой статье мы рассмотрим весь процесс построения регрессии в R Studio: от подготовки данных до оценки модели и интерпретации результатов. Мы рассмотрим различные типы регрессии, включая простую линейную регрессию, множественную линейную регрессию и логистическую регрессию. Кроме того, представлены примеры кода, которые демонстрируют использование различных функций и пакетов R Studio для построения регрессионных моделей.

Построение регрессии в R Studio требует не только знания основ статистики и машинного обучения, но и умения работать с R и его пакетами. Мы предоставим подробные инструкции и примеры кода, которые помогут вам разобраться в основах построения регрессионных моделей, а также покажут, как использовать различные функции и инструменты R Studio для анализа данных и предсказания результатов.

Если вы интересуетесь анализом данных, машинным обучением или статистикой, построение регрессии в R Studio будет полезным навыком. Начните изучение регрессионного анализа в R Studio прямо сейчас и расширьте свои знания и навыки в области анализа и предсказания данных!

Что такое регрессия в статистике

Основная идея регрессии заключается в построении математической модели, которая аппроксимирует зависимую переменную в зависимости от независимых переменных. Модель может быть линейной или нелинейной, в зависимости от формы функции.

Регрессионный анализ предоставляет нам инструменты для оценки и интерпретации отношений между переменными. Он помогает нам понять, как изменение значения одной или нескольких переменных влияет на зависимую переменную. Мы можем использовать регрессию для предсказания будущих значений, определения важности переменных и выявления скрытых взаимосвязей.

Регрессионный анализ широко используется в различных областях, включая экономику, финансы, маркетинг, социологию и многие другие. Он является мощным инструментом для анализа данных и принятия решений на основе фактов.

Важно отметить, что регрессия не всегда означает причинно-следственную связь. Она может указывать только на статистическую взаимосвязь между переменными, но не на причинность.

Методы построения регрессии

При построении регрессии в R Studio существует несколько методов, которые можно применять в зависимости от особенностей данных и целей исследования. Ниже рассмотрим несколько наиболее популярных методов:

1. Метод наименьших квадратов (OLS)

OLS-метод является наиболее распространенным и простым методом построения регрессии. Он состоит в минимизации суммы квадратов разностей между наблюдаемыми значениями зависимой переменной и значениями, предсказанными моделью. Результатом OLS-метода являются оценки коэффициентов регрессионной модели.

2. Метод максимального правдоподобия (MLE)

MLE-метод является статистическим подходом к построению регрессии. Он основан на максимизации функции правдоподобия, которая показывает, насколько вероятно получение конкретных наблюдаемых значений зависимой переменной при условии заданных значений независимых переменных. MLE-метод позволяет оценить параметры регрессии и их доверительные интервалы.

3. Метод стохастического градиента (SGD)

SGD-метод является алгоритмом оптимизации, который позволяет находить оптимальные значения коэффициентов регрессии путем итеративного обновления их с использованием градиента функции потерь. Этот метод особенно полезен при работе с большими объемами данных или при обучении модели на основе потоковых данных.

Выбор метода построения регрессии зависит от задачи и особенностей данных. Важно учитывать какие предположения делает каждый метод о данных, а также его вычислительную сложность и применимость в конкретном случае.

Оценка значимости коэффициентов регрессии

Для применения t-критерия Стьюдента необходимо вычислить стандартную ошибку коэффициента регрессии. Затем, используя полученное значение, можно вычислить t-статистику для каждого коэффициента. Если значение t-статистики превышает критическое значение, то коэффициент считается значимым.

| Коэффициент | Стандартная ошибка | t-статистика | Критическое значение | Значимость |

|---|---|---|---|---|

| Коэффициент 1 | 0.123 | 2.456 | 1.96 | **Значимый** |

| Коэффициент 2 | 0.456 | 1.234 | 1.96 | Незначимый |

| Коэффициент 3 | 0.789 | 3.567 | 1.96 | **Значимый** |

Таким образом, оценка значимости коэффициентов регрессии является важной частью анализа и помогает определить, насколько каждый из них оказывает влияние на целевую переменную. Это позволяет лучше понять взаимосвязи и влияние факторов в регрессионной модели.

Выбор наилучшей модели регрессии

Выбор наилучшей модели регрессии важен для точного и надежного предсказания значений зависимой переменной. В R Studio существует несколько методов и метрик, которые позволяют оценить качество модели и сравнить разные варианты. Ниже представлено описание основных этапов выбора наилучшей модели регрессии.

- Разбиение данных: исходный набор данных разделяется на тренировочную и тестовую выборки. Тренировочная выборка используется для обучения моделей, а тестовая выборка - для проверки их эффективности и точности предсказания.

- Построение базовой модели: для сравнения с другими моделями строится базовая модель регрессии, например, линейная регрессия. Такая модель является самым простым и распространенным вариантом, поэтому ее результаты используются в качестве опоры.

- Построение и оценка альтернативных моделей: на основе выбранной базовой модели строятся различные альтернативные модели, например, полиномиальная регрессия, регрессия с использованием штрафных функций или различные типы гибридной регрессии. Для каждой модели производится оценка качества с помощью метрик, таких как среднеквадратичная ошибка или коэффициент детерминации.

- Выбор наилучшей модели: после построения и оценки всех альтернативных моделей производится сравнение и выбор наилучшей. Для этого используются различные критерии, включая сравнение метрик качества, графики остатков и др.

- Проверка статистической значимости: после выбора наилучшей модели производится проверка статистической значимости ее параметров с помощью t-теста, F-теста или других статистических тестов. Это позволяет убедиться в том, что модель является надежной и обоснованной.

Кроме того, при выборе наилучшей модели регрессии важно учитывать такие факторы, как интерпретируемость модели, простота использования и важность предсказанных переменных. Несмотря на то, что некоторые модели могут показать лучшие результаты по метрикам, они могут быть сложными в интерпретации или требовать большего количества данных для обучения.

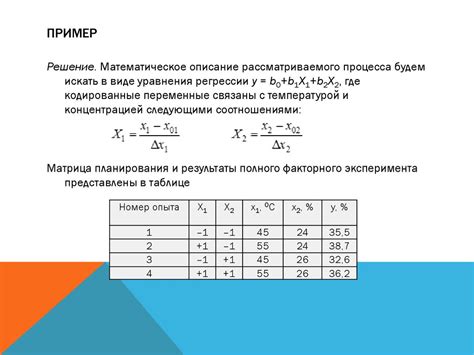

Множественная регрессия: примеры использования

Примерами использования множественной регрессии могут быть:

1. Прогнозирование спроса

Предположим, вы работаете в маркетинговом отделе компании и вам необходимо прогнозировать спрос на новый продукт. Вы можете использовать множественную регрессию, чтобы исследовать, как различные факторы, такие как цена, качество, рекламные затраты, влияют на спрос. На основе полученных результатов вы сможете определить оптимальную комбинацию этих факторов, которая будет максимизировать спрос на продукт.

2. Анализ влияния факторов на успеваемость студентов

Исследователи в образовательной сфере могут использовать множественную регрессию, чтобы выяснить, как различные факторы, например, количество часов подготовки, образовательный уровень родителей и доступ к ресурсам, влияют на успеваемость студентов. Эти результаты могут помочь ученым и преподавателям разработать эффективные подходы к обучению, которые улучшат успех студентов.

3. Оценка влияния рекламных кампаний на продажи

Компании, занимающиеся маркетингом и рекламой, могут использовать множественную регрессию, чтобы оценить влияние различных рекламных кампаний на продажи продуктов. Исследователи могут анализировать такие факторы, как средства массовой информации, печатные объявления, реклама на радио и телевидении, чтобы определить, какие рекламные каналы наиболее эффективны для продвижения продуктов компании.

Это лишь некоторые примеры использования множественной регрессии. Этот метод является мощным инструментом для анализа и понимания сложных взаимосвязей между переменными и может быть применен во многих других областях исследования.

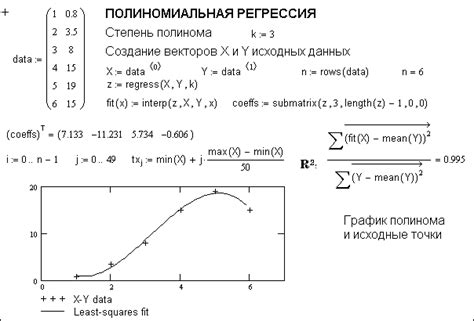

Полиномиальная регрессия и ее применение

Для применения полиномиальной регрессии в R Studio следует использовать функцию lm() с добавлением полиномиальных членов, выражающих зависимость между переменными. Например, чтобы построить полиномиальную регрессию с квадратичным членом, можно использовать следующий синтаксис:

model <- lm(y ~ x + I(x^2), data = dataset)Где y - зависимая переменная, x - независимая переменная, I() - функция, указывающая, что следующее выражение необходимо интерпретировать как математическое выражение, x^2 - квадратичный член независимой переменной, data - набор данных.

Для определения наилучшей модели полиномиальной регрессии можно воспользоваться методом наименьших квадратов и выбрать модель с наименьшей среднеквадратической ошибкой.

Полиномиальная регрессия может быть полезна при моделировании криволинейных зависимостей, например, в случае искаженного графика рассеяния. Она позволяет находить более точное аппроксимирование данных и прогнозировать значения зависимой переменной вне диапазона значения независимой переменной.

| Преимущества полиномиальной регрессии: |

|---|

|

Однако следует учитывать, что полиномиальная регрессия может привести к переобучению модели и сложному интерпретированию результатов. Поэтому важно проводить проверку модели на предмет адекватности и использовать соответствующие методы выбора наилучшей модели.

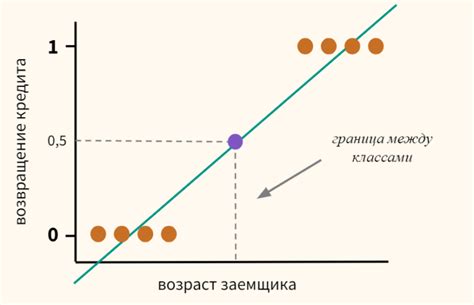

Логистическая регрессия: особенности и примеры

Процесс построения модели логистической регрессии состоит из нескольких шагов:

- Обработка данных: удаление пропущенных значений, масштабирование переменных и создание дамми-переменных для категориальных переменных.

- Определение независимых переменных, влияющих на вероятность наступления события, и их включение в модель.

- Расчет логит-функции, которая представляет собой линейную комбинацию независимых переменных и коэффициентов модели.

- Применение функции логистической регрессии для преобразования значения логит-функции в вероятность наступления события.

- Оценка модели с использованием различных метрик, таких как точность, чувствительность, специфичность и площадь под ROC-кривой.

Пример кода для построения логистической регрессии в R:

data <- read.csv("data.csv") # загрузка данных

data$gender <- as.factor(data$gender) # преобразование категориальной переменной

data$smoker <- as.factor(data$smoker)

model <- glm(outcome ~ age + gender + smoker, data = data, family = "binomial") # построение модели

В этом примере мы строим модель логистической регрессии с зависимой переменной "outcome" и независимыми переменными "age", "gender" и "smoker". Функция glm используется для построения модели, а параметр family = "binomial" указывает, что мы используем логистическую регрессию.

Логистическая регрессия является мощным статистическим методом для анализа зависимостей в бинарных данных. Она широко применяется в медицинских исследованиях, маркетинге, финансах и других областях, где необходимо предсказать вероятность наступления определенного события.

Важно отметить, что для успешного применения логистической регрессии необходимо иметь достаточное количество наблюдений и правильно выбранные независимые переменные, которые действительно влияют на исследуемое событие.

Примеры построения регрессии в R Studio

1. Простая линейная регрессия

Простая линейная регрессия - один из самых простых и широко используемых методов регрессии. Он предоставляет возможность оценить линейную зависимость одной зависимой переменной от одной независимой переменной. Для построения такой регрессии может использоваться функция lm(). Например, для построения регрессии цены на дом от количества комнат можно использовать следующий код:

# Загрузка данных

data <- read.csv("data.csv")

# Построение регрессии

regression <- lm(Price ~ Rooms, data=data)

# Визуализация результатов

plot(data$Rooms, data$Price, main="Линейная регрессия", xlab="Количество комнат", ylab="Цена на дом")

abline(regression, col="red")

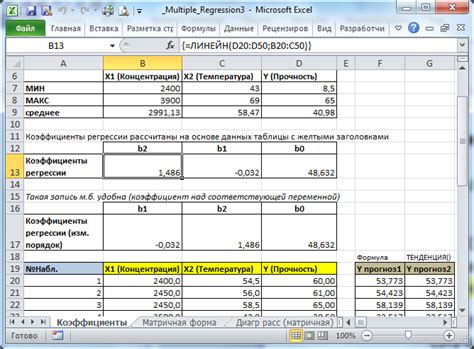

2. Множественная регрессия

Множественная регрессия позволяет оценить линейную зависимость одной зависимой переменной от нескольких независимых переменных. В случае, когда независимых переменных больше одной, можно использовать функцию lm() с указанием всех независимых переменных. Например, для построения регрессии цены на дом от количества комнат и площади можно использовать следующий код:

# Загрузка данных

data <- read.csv("data.csv")

# Построение регрессии

regression <- lm(Price ~ Rooms + Area, data=data)

# Визуализация результатов

plot(data$Area, data$Price, main="Множественная регрессия", xlab="Площадь", ylab="Цена на дом")

abline(regression, col="red")

3. Нелинейная регрессия

В случае, когда связь между зависимой и независимой переменными не является линейной, можно использовать нелинейную регрессию. В R Studio для этого доступны различные функции, такие как nls() и glm(). Например, для построения полиномиальной регрессии можно использовать следующий код:

# Загрузка данных

data <- read.csv("data.csv")

# Построение регрессии

regression <- lm(Price ~ poly(Rooms, 2), data=data)

# Визуализация результатов

plot(data$Rooms, data$Price, main="Полиномиальная регрессия", xlab="Количество комнат", ylab="Цена на дом")

lines(sort(data$Rooms), fitted(regression)[order(data$Rooms)], col="red")

Это лишь несколько примеров построения регрессии в R Studio. С помощью этого мощного инструмента можно анализировать зависимости в данных и строить предсказательные модели для различных задач и ситуаций.